Quaderns de Psicologia | 2026, Vol. 28, Nro. 1, e2232 | ISSN: 0211-3481 |

https://doi.org/10.5565/rev/qpsicologia.2232

https://doi.org/10.5565/rev/qpsicologia.2232

Inteligência artificial, desejo e apagamento: Uma perspectiva psicanalítica

Artificial Intelligence, Desire, and Erasure: A Psychoanalytic Perspective

Paulo Victor dos Reis Silveira

João Luiz Leitão Paravidini

Anamaria Silva Neves

Universidade Federal de Uberlândia

RESUMO

Neste artigo, são discutidas questões éticas no desenvolvimento e uso da Inteligência Artificial (IA), com foco na relação entre sujeito e máquina. Utilizando uma perspectiva psicanalítica, a análise aborda o apagamento do sujeito no contexto da IA, considerando o desejo inconsciente e os discursos de Lacan. Destaca-se como a IA perpetua desigualdades sociais e econômicas, exacerbando a exploração de trabalhadores na mineração de lítio e na rotulagem de dados. A IA também captura o desejo do usuário, prometendo satisfazer suas necessidades, mas sempre mantendo uma falta inerente, conforme a teoria lacaniana. Além disso, o artigo explora a ética nos algoritmos de IA, incluindo questões de privacidade, viés e responsabilidade. Sugere-se que a IA promove o apagamento do sujeito, tanto no desenvolvimento quanto como consumidor desejante. O artigo argumenta que a construção de IAs éticas deve considerar a implicação subjetiva e social dos usuários, propondo a psicanálise como ferramenta crucial.

Palavras-chave: Inteligência artificial; Psicanálise; Ética; Desejo inconsciente

ABSTRACT

In this article, it is discussed the ethical issues in the development and use of Artificial Intelligence (AI), focusing on the relationship between subject and machine. Using a psychoanalytic perspective, the analysis addresses the erasure of the subject in the context of AI, considering unconscious desire and Lacan’s discourses. It highlights how AI perpetuates social and economic inequalities, exacerbating the exploitation of workers in lithium mining and data labeling. AI captures the user’s desire, promising to satisfy their needs, but always maintaining an inherent lack, according to Lacanian theory. Additionally, the article explores ethics in AI algorithms, including privacy, bias, and responsibility issues. It suggests that AI promotes the erasure of the subject, both in development and as a desiring consumer. The article argues that the construction of ethical AIs must consider the subjective and social implications of users, proposing psychoanalysis as a crucial tool.

Keywords: Artificial intelligence; Psychoanalysis; Ethics; Unconscious desire

INTRODUÇÃO

As questões éticas relacionadas ao campo das inteligências artificiais (IAs) são um assunto amplamente discutido. Abgail Thorn (2023) apresentou suas ideias em Here’s What Ethical AI Really Means (Isso é o que IA ética realmente significa — tradução própria), nas quais são apresentados uma série de desafios éticos e reflexões sobre as soluções para estabelecer um processo mais justo e menos prejudicial no desenvolvimento de inteligências artificiais. Seu trabalho contém uma visão crítica sobre como os desafios são mais complexos do que se imagina e algumas dessas visões serão discutidas nesse artigo em diálogo com a Psicanálise. Thorn (2023) formula uma instigante proposição em seu vídeo:

Mesmo que construíssemos uma IGA (Inteligência Geral Artificial) mal alinhada, seu poder não viria da tecnologia, mas dos sistemas humanos nos quais essa tecnologia está inserida. Então, quando as pessoas falam sobre IA ética, talvez não devêssemos pensar em Skynet. Talvez devêssemos pensar em condições de trabalho, mudanças climáticas e como fazer a economia servir aos humanos, em vez do contrário. Não devemos presumir que a IGA é inevitável e tentar adicionar a ética como uma reflexão posterior, mas sim perguntar como podemos fazer da justiça, sustentabilidade e equidade o objetivo de cada pedaço de tecnologia que construímos. Se realmente queremos criar uma IA ética, então talvez gostaríamos de considerar essa perspectiva. Não há computação ética sob o capitalismo!

Essa perspectiva é muito coerente com o caminho percorrido pela autora, uma vez que ela apresenta críticas e reflexões em cada uma das possibilidades de refletir sobre o problema ético das IAs, passando por tópicos que servirão de plano de fundo para a presente discussão. O processo de criação e evolução da IA esbarra em implicações diretas no campo social e subjetivo, motivo pelo qual a Psicanálise será acionada para fomentar conexões no processo de articulação entre sujeito e máquina por meio do usuário.

O trabalho de Thorn (2023) apresenta uma reflexão instigante que reconfigura o debate tradicional sobre ética e IA. Pode-se observar que o poder de uma IGA não reside intrinsecamente na tecnologia, mas está subordinado às estruturas humanas — sociais, políticas e econômicas — que, por sua vez, encontram-se à mercê das esferas de poder que as controlam, configurando e amplificando os potenciais impactos. É a forma como essa ferramenta é empregada que determinará esses impactos, os quais podem exacerbar ainda mais a exploração, as desigualdades e as opressões.

Segundo Lenhart Schubert (2020), a linguística computacional busca processar a linguagem humana para facilitar interações entre humanos e máquinas. Há uma aproximação entre humanos e máquinas no que diz respeito ao campo da linguagem, seja ela humana ou computacional. Para o autor, essa conexão permite que a compreensão computacional forneça insights valiosos tanto sobre a inteligência quanto sobre os processos da mente humana.

Nos últimos anos, o progresso no campo das IAs tem sido notável. O investimento em startups de IA cresceu de 670 milhões de dólares para 36 bilhões em 2020, conforme Bergur Thormundsson (2023), e tecnologias como IA de borda, Redes Adversárias Generativas (GANs) e Transformadores Pré-Treinados Generativos (GPT) vêm revolucionando tarefas humanas com extrema eficiência. Essas tecnologias, derivadas da linguística computacional, têm mostrado impacto significativo na automação, criação de conteúdos e personalização de serviços.

A IA de borda, segundo Yifei Shen et al. (2023), implementa inteligência diretamente nos dispositivos dos usuários, proporcionando maior eficiência e privacidade ao reduzir a dependência da nuvem. Já as IAs de geração de imagem, segundo Steven Durr et al. (2022), utilizam como método treinamento GANs, que empregam geradores e discriminadores para criar amostras realistas, têm aplicações em áreas como criação de imagens e simulações visuais. Por sua vez, conforme Michele Salvagno et al. (2023), o GPT, exemplificado pelo ChatGPT, representa um avanço na simulação de interações humanas, utilizando algoritmos de aprendizado de máquina e processamento de linguagem natural para atender às necessidades dos usuários.

A evolução das tecnologias de IA acontece com custos altos tanto no meio ambiente quanto na exploração humana e pode perpetuar estereótipos enviesados que afetam as minorias. É importante que seja explicitado como tais tecnologias, que por um lado apresentam soluções para problemáticas extremamente complexas, por outro, atritam com a cultura e a subjetividade, conforme será apresentado nos próximos tópicos. Os principais grupos afetados são pessoas trans, por IAs de segurança, trabalhadores mineradores que trabalham em condições de alto prejuízo a sua saúde e pessoas de baixa renda que se submetem a condições de trabalho sem nenhuma proteção trabalhista na rotulagem de dados (Thorn, 2023).

Considerados os argumentos apresentados, este trabalho tem como objetivo evidenciar o apagamento do sujeito no desenvolvimento e produção de IAs e a relação com o desejo inconsciente. Para tal, buscar-se-á demonstrar como as etapas do processo de desenvolvimento dessas tecnologias apresentam problemas e desafios éticos, desde a formação da base de dados até a parte física e material. No segundo tempo, será apresentada uma leitura da interação entre humanos e máquinas por meio do discurso do mestre de Jacques Lacan (1969–1970/1992), a partir do qual a IA pode servir como dispositivo cujo imperativo é capturar o desejo do usuário cifrando-lhe um objeto desejável. Todas essas etapas, conforme a hipótese norteadora, confluem para uma perspectiva de apagamento do sujeito dividido.

ÉTICA E IA: A PROBLEMÁTICA DA BASE DE DADOS

As bases de dados são essenciais para a IA, fornecendo material bruto para seus algoritmos. O uso desses dados levanta questões éticas, como privacidade, propriedade intelectual e viés. Além disso, há o risco de viés nos algoritmos de IA, que podem perpetuar ou até mesmo amplificar preconceitos existentes se forem treinados em dados tendenciosos. Na medida em que os dados são transformados, ocorre então o data flattening (achatamento de dados).

Segundo Thorn (2023), o achatamento de dados é um fenômeno que ocorre quando os sistemas de IA coletam e processam grandes volumes de dados de maneira indiscriminada, sem considerar o contexto, a origem ou o consentimento dos indivíduos aos quais os dados pertencem. No entanto, o método de coleta de dados levanta diversas questões éticas, pois nenhum consentimento é obtido, nenhum cuidado ou regulamentação é realizado; e os profissionais que desenvolvem esses modelos assumem que podem fazer dessa forma, pois se trata somente de dados, apenas abstrato e imaterial. A verdade, porém, é que os dados de treinamento são feitos por e a partir de pessoas.

Além disso, a intratabilidade dos dados no produto final da IA apresenta outro desafio significativo. Chama-se de produto final o que foi gerado por uma IA após uma solicitação de um usuário, como no caso de text-to-image, no qual um usuário pode, por exemplo, pedir para uma IA “desenhar um papagaio no estilo de Romero Brito”. Uma vez que os dados são processados e transformados pelo algoritmo de IA, torna-se extremamente difícil, se não impossível, rastrear os dados de saída até a sua fonte original. Isso tem implicações diretas nos critérios dos direitos autorais, pois não há uma escolha explícita sobre permitir ou não que uma IA treine com as criações dos artistas. Além disso, torna-se inviável verificar se houve violação autoral, uma vez que não se pode rastrear quais dados específicos foram usados na geração de determinadas imagens. A falta de transparência em relação a como os dados são utilizados e transformados pode também resultar em desfechos tendenciosos ou injustos em aplicações de IA voltadas para a segurança. (Thorn, 2023).

Essa impossibilidade de identificar o autor inicial naquilo que é produzido levanta questões éticas importantes sobre a responsabilidade e transparência das empresas que desenvolvem IAs, pois pode ser árduo determinar quem é responsável por uma decisão desse programa, se é o usuário, o programador ou uma falha de programa (bug) e como essa decisão foi tomada pelo programa. Essas questões se tornam ainda mais pertinentes à medida que a IA se integra cada vez mais em áreas críticas da sociedade, como saúde e justiça criminal. Outro problema é que certos processos que envolvem a tomada de decisão de uma IA, como, por exemplo, por que ela escolheu certo perfil para contratação na análise de currículo, precisam ser identificados para que se possa dar uma explicação ao candidato. Esse processo, que deveria ser acessível, é extremamente trabalhoso e pouco eficiente, fazendo com que os sujeitos afetados por tais decisões fiquem impossibilitados de receber uma resposta justa sobre o porquê dessas escolhas terem sido feitas.

Uma forma de resolver o último problema citado seria criar uma outra IA para rastrear e entender o processo de decisão pelas técnicas de explicação do modelo, explicação do resultado e inspeção do modelo, conforme Ulrich Aïvodji et al. (2019). Embora essas técnicas possam ser benéficas ao interpretarem os dados, elas podem ser usadas de maneira negativa, sofrendo fairwashing, que é o processo de promover a falsa percepção de que um modelo de aprendizado de máquina respeita alguns valores éticos. Isso significa que a IA cria um motivo ético para uma tomada de decisão não ética. Esse processo não auxilia a pensar sobre o que pode ser feito quando o usuário utiliza a ferramenta de uma forma não ética ou de forma incorreta que pode produzir resultados não éticos, como no caso de IAs nos sistemas de segurança dos aeroportos.

Ao explorar as questões éticas em torno do uso de dados na IA, é crucial examinar como esses problemas se manifestam na prática, particularmente no viés, além dos estereótipos identitários que podem ser perpetuados e amplificados por sistemas de IA que não levam em conta a complexidade e a fluidez das identidades de gênero, como veremos a seguir.

VIÉS E ESTEREÓTIPOS IDENTITÁRIOS

Thorn (2023) levanta um dilema que envolve a complexidade e as limitações da detecção de gênero em sistemas de segurança de aeroportos, exemplificado pela máquina de escaneamento corporal. A máquina, ao ser projetada por pessoas cisgênero, baseia-se em pressupostos binários de gênero, o que causa situações constrangedoras para indivíduos transgêneros. Ao qualificar a pessoa em homem ou mulher, ela identifica características anatômicas de forma binária, ignorando a diversidade e a não conformidade de gênero. Isso resulta em constrangimentos e situações humilhantes para pessoas trans que possuem características físicas fora dos padrões tradicionais de gênero, expondo as falhas de um sistema de vigilância que não considera a complexidade e a fluidez das identidades de gênero. Esse exemplo evidencia como a tecnologia incorpora visões de mundo limitadas e reforça estereótipos de gênero, que afetam além de destacar a importância de repensar as abordagens técnicas para garantir a inclusão e equidade em sistemas de IA em contextos sociais complexos.

Simone Browne (2010, p. 134) amplia o termo “epidermalização”, de Frantz Fanon (1952/2020), na obra Pele negra, Máscaras Brancas, que é utilizado para descrever o processo pelo qual os significados são projetados nas características físicas de uma pessoa, muitas vezes resultando em estereótipos e preconceitos. A extensão do conceito seria a “epidermalização digital”, que inclui o domínio digital, no qual as tecnologias de vigilância projetam informações e significados no corpo, como no caso citado anteriormente, dos scanners em aeroportos (Browne, 2010, p. 134).

Há, portanto, implicações subjetivas na medida em que a padronização de características cria um movimento de apagamento das diferenças que constituem o sujeito. É relevante pensar sobre como esses modelos podem influenciar no processo cultural em que estão inseridos. Mesmo explorando a parte virtual do desenvolvimento das IAs, é importante entender que ela não é apenas uma entidade digital, mas também tem a dimensão física marcada pelo trabalho humano como necessário para sua criação.

A PARTE HUMANA DA IA: A MINERAÇÃO DE LÍTIO E A ROTULAGEM DE DADOS

A IA é uma entidade física que requer recursos tangíveis para existir e operar. A IA depende de eletricidade e do lítio, um recurso fundamental nas baterias que alimentam dispositivos e infraestruturas tecnológicas. No entanto, a obtenção de lítio não é um processo simples ou limpo. O processo de extração de lítio é altamente poluente, consumindo recursos não renováveis e contribuindo para a mudança climática. Esse processo é feito, primordialmente, utilizando a força de trabalho humana. Uma IA precisa de um servidor para realizar seus treinamentos e quanto maior o servidor, melhor o potencial da qualidade de uma IA. Como um servidor é feito de computadores e esses precisam de uma infraestrutura gigantesca para funcionar, há um grande consumo de recursos naturais (Thorn, 2023).

Segundo Thorn (2023), a mineração de lítio gera danos humanos e ambientais, cujos custos recaem sobre trabalhadores e a população. Essa realidade contradiz a ideia popular de que a tecnologia, incluindo a IA, é “limpa”. A indústria da IA consome muitos recursos e tem um impacto ambiental significativo.

A rotulagem de dados, essencial para treinar IAs, é realizada por trabalhadores em condições precárias, que anotam e categorizam informações para que os sistemas aprendam a partir delas. Esse é um trabalho invisível e mal remunerado, mesmo sendo fundamental para o funcionamento dos sistemas de IA, desde o reconhecimento de voz até a detecção de objetos em imagens (Thorn, 2023).

Além disso, a IA é vulnerável às mudanças climáticas e à ação dos trabalhadores. Se os trabalhadores que atuam na mineração, transporte ou rotulagem de dados não puderem ou não quiserem fazer seu trabalho, o sistema pode parar. Da mesma forma, as mudanças climáticas podem interromper o fluxo de componentes necessários para a IA, através de navios (Thorn, 2023).

Os trabalhadores nas minerações de lítio e das rotulagens de dados são excluídos do produto final como partes descartáveis do processo de produção, mesmo que tenha sido justamente graças a esses trabalhadores que o desenvolvimento tecnológico no campo da IA decorreu de forma tão acelerada.

Torna-se fundamental, diante dos avanços e impactos da IA, acessar outros campos de análise para pensar sobre o que torna a IA tão importante ou sedutora. Aqui, a psicanálise nos auxilia na reflexão sobre o que torna a IA tão atrativa, tanto para os usuários quanto para os criadores.

PSICANÁLISE E IA: USUÁRIO E A IA NA ÓTICA DOS DISCURSOS

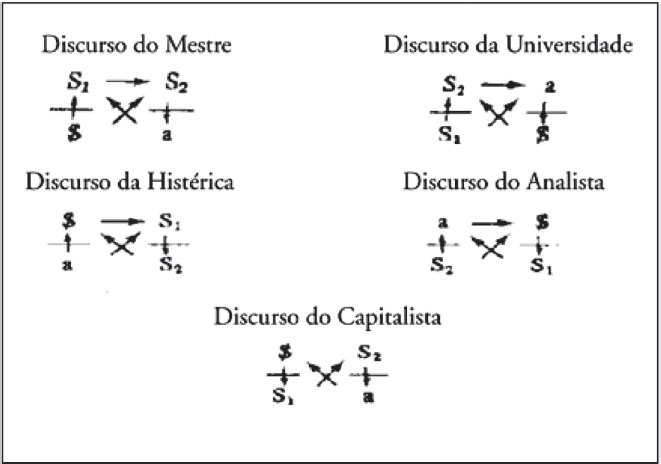

No Seminário 17, Lacan (1969–1970/1992) apresenta a ideia de que a estrutura do laço social é construída por meio de discursos. Esses discursos são compostos por quatro elementos fundamentais: o objeto pequeno a (a), que representa o objeto de desejo; o sujeito barrado ($), que simboliza o sujeito do inconsciente; o significante mestre (S1), que é o significante que domina ou determina a estrutura do sujeito; e o saber (S2), que se refere ao conhecimento que o sujeito possui do mundo.

Os discursos são representados pelos matemas apresentados na Figura 1:

Figura 1. Matemas dos discursos

Nota: Reproduzido de Lacan (1972, p. 40).

No discurso do mestre, a impossibilidade reside entre o mestre (S1) e o saber (S2), sugerindo a impossibilidade de governar o que não se domina, o desafio de comandar o saber e a incapacidade de fazer o mundo do mestre funcionar. No discurso histérico, a impossibilidade é encontrada entre o sujeito barrado ($) e o significante mestre (S1), revelando a incapacidade do sujeito histérico de dominar o significante mestre. No discurso universitário, a impossibilidade está entre o saber (S2) e o objeto pequeno a, indicando a impossibilidade de educar através do comando do saber.

O discurso do capitalista (Lacan, 1969-1970/2011), em relação à sua estrutura, faz referência ao discurso do mestre. Há uma modificação no lugar do saber entre o discurso do senhor antigo e o senhor moderno, que se chama capitalista. Esse discurso é considerado um deslizamento do discurso do mestre. Lacan destaca que todo discurso está atrelado aos interesses do sujeito. Se o interesse na sociedade capitalista é inteiramente mercantil, há uma mutação capital de um discurso ao outro. No discurso do capitalista, o sujeito passa a ser reduzido a um consumidor, enquanto o objeto causa de seu desejo se torna um gadget — que ocupa a posição do outro do discurso capitalista. O saber (S2) desse discurso é o da ciência/tecnologia; enquanto o significante-mestre (S1), o poder, é o capital.

A estrutura do discurso do capitalista evidencia a razão pela qual esse discurso não promove o laço social. O circuito do discurso passa a ser fechado, em que cada termo é comandado pelo anterior e orienta o seguinte. Isso significa que o sujeito comanda e o objeto a, por sua vez, pode também comandar o sujeito, fazendo um circuito fechado nele mesmo, ou seja, não há circulação simbólica entre os elementos do discurso, diferente dos outros discursos vistos anteriormente, que permitem um movimento dinâmico e uma troca significativa entre os sujeitos e os elementos que compõem o laço social. É esse circuito fechado que não permite a circulação do discurso do capitalista com os outros discursos (Lacan, 1972, p. 51).

Para Jamile Luz Morais Monteiro (2019), o foco do discurso capitalista é outro: o gozo, entendido como a busca incessante por satisfação. Nesse modelo, o saber (representado pelo S2) se reduz a um instrumento de trabalho voltado para a produção de objetos que prometem prazer ao sujeito consumidor. Enquanto o sujeito consome os objetos, ele também é consumido por eles, em um ciclo sem fim que não oferece satisfação duradoura (Monteiro, 2019).

Segundo Hub Zwart (2017), o “matema do desejo” ($ ◊ a) descreve a dinâmica entre o sujeito e o objeto a. O símbolo $ (o “S barrado”) representa o sujeito dividido, marcado pela falta e pelo sofrimento gerado pelo desejo. O a, por sua vez, é o objeto impossível e inalcançável que causa o desejo, algo que nunca pode ser plenamente obtido. O losango (◊) entre os dois elementos pode ser interpretado como uma seta que aponta em ambas as direções, indicando que o desejo não apenas se orienta em direção ao objeto perdido, mas também pode ser estimulado por objetos que funcionam como substitutos atraentes. Esses substitutos revelam ao sujeito o que lhe falta, oferecendo a ilusão de que seu desejo essencial poderia ser finalmente satisfeito, ainda que isso seja apenas um engano (Zwart, 2017).

Os objetos produzidos dentro desse discurso, como aparelhos tecnológicos ou artefatos modernos, são elementos que prometem uma satisfação extra ao sujeito, mas que na verdade reforçam sua sensação de falta. Essa lógica cria uma relação direta entre o sujeito e o objeto, sem a mediação de um laço social significativo. O consumo não conecta as pessoas entre si, mas isola o sujeito em sua busca incessante por novos objetos (Monteiro, 2019).

O sujeito nesse discurso é levado a acreditar que pode alcançar uma satisfação plena por meio desses objetos de consumo, representados no matema anterior como a, que representa o objeto a. O objeto a, segundo Lacan (1964/1993), “é algo de que o sujeito, para se constituir, se separou como órgão. Isso vale como símbolo da falta, quer dizer, do falo, não como tal, mas como fazendo falta” (p. 101), ou seja, está associado a uma dimensão irrepresentável, que não pode ser completamente capturada pela linguagem. Toda tentativa de representá-lo resulta em um excesso ou em um resto que escapa à simbolização.

Esse excesso, denominado mais-de-gozar, refere-se a uma perda inerente ao funcionamento dos discursos e da linguagem. No ato de significar ou de buscar um sentido, uma parte desse gozo se dissipa, criando uma sensação de falta ou incompletude que caracteriza o sujeito. Essa dinâmica aponta para o aspecto do real na estrutura da linguagem, um real que não se reduz ao que pode ser dito ou compreendido (Monteiro, 2019).

O objeto a, portanto, não é algo tangível ou concreto, mas uma função que marca a falta estrutural do sujeito. Ele sustenta o desejo, ao mesmo tempo em que evidencia sua impossibilidade de ser plenamente satisfeito. O gozo que ele sinaliza é sempre inacessível, e a busca incessante por alcançá-lo reforça a condição de incompletude que fundamenta a subjetividade (Monteiro, 2019).

Lacan (1954/2010, p. 37) aborda sobre a relação entre o eu e o mundo simbólico, argumentando que o homem é um sujeito descentrado porque está inserido em um jogo de símbolos. As máquinas são construídas a partir desse mesmo mundo simbólico e dos mesmos jogos, sendo feitas a partir da linguagem. A partir desse momento, aquilo que constitui o ser do sujeito surge neste mundo. A tecnologia informatizada e digital é intimamente conectada com a linguagem, a matemática e os códigos de computador (marcado pela “ordem simbólica”), e tal proximidade entre humanos e máquinas é muito mais intensa do que a filosofia da época parecia presumir.

Embora Lacan não esteja se referindo à IA, Zwart (2017) estende a noção de que a máquina tecnológica discutida por Lacan inclui os artefatos modernos, como gadgets, nos quais a IA pode ser incluída. A modernidade nos cerca de dispositivos eletrônicos que ordenam serem usados, se comunicando com o usuário de forma articulada, sofisticada e insistente. Tais dispositivos estão repletos de linguagem, funcionando como portadores de mensagens e reivindicações, como um superego eletrônico.

Há no objeto a, conforme visto nos parágrafos anteriores, algo da falta física e da intangibilidade. Essa falta de concretude que permite que a IA e outros gadgets prometam compensar a falta presente nele. O significante (de presença ou ausência) oblitera a coisa orgânica na medida em que a comunicação entre sujeitos se medeia pela tecnologia, possibilitando a ideia de que os gadgets também se comuniquem entre si a partir do usuário. Uma forma de visualizar melhor essa comunicação entre dispositivos é como as informações dos usuários podem ser utilizadas na personalização de propagandas dentro de aplicativos de redes sociais. O usuário recobre aquilo que o objeto a invoca, remetendo ao desejo de um substituto, e sua imaterialidade faz pensar na possibilidade de uma IA que simbolize isso de forma natural e contínua.

A IA surge como promessa de fornecer maior autonomia ao sujeito, no qual seu conhecimento é ampliado de forma complexa na interação tecnológica. Essa é a promessa da tecnologia, um ser humano que possui seus atributos ampliados na medida em que a suas incapacidades (aquilo que lhe falta) são retiradas, dando lugar a um novo sujeito capaz. Mas a incoerência posta é que as tecnologias se desenvolvem, mas esse novo sujeito ampliado só é capaz de se desenvolver dentro desse ambiente tecnológico. Não há mais espaço para um sujeito que se desenvolve sem um GPS ou uma ferramenta de busca como o Google para orientá-lo. Esse sujeito é um sujeito desatualizado, exatamente como os próprios aplicativos que os guiam ficam quando ignorados.

Assim, tomando como base o discurso capitalista e a IA como objeto a (no lugar de produto), é possível evidenciar que não há possibilidade de laço social, uma característica marcante desse discurso. Porém, os gadgets revelam uma acessibilidade íntima (e, portanto, vulnerabilidade) do desejo inconsciente para o funcionamento desses dispositivos inteligentes, fazendo surgir um superego novo e coletivo que submete o sujeito à lembrança constante de que ele deve aproveitar a vida constantemente e de forma absoluta, como um $ (sujeito barrado/sujeito do inconsciente) que é colocado para trabalhar para corresponder a essas expectativas, que só consegue fazê-lo conforme surgem novas tecnologias, cada vez mais eficientes.

A partir de uma perspectiva lacaniana, o que é perturbador sobre esses dispositivos tecnológicos é a proximidade que eles alcançam, devido à habilidade de imitar o objeto ausente de um jeito convincente e sem causar tanto estranhamento. Eles surgem no mundo exterior como substitutos atraentes, propondo-se a abordar deficiências e anseios de maneira surpreendentemente direta. É exatamente essa capacidade de imitar tão bem o objeto faltante que proporciona a sensação inquietante.

A dialética de Lacan, da tecnologia e do desejo, envolve três momentos decisivos. Primeiro, a experiência traumática primordial de separação ou perda de objeto. Em seguida, o desejo de substituir o objeto ausente com a ajuda de substitutos, como objetos de desejo. E, finalmente, a proposição de que os novos dispositivos tecnológicos emergentes focam sua atenção nos sujeitos desejosos de maneira bastante direta. Em outras palavras, esses dispositivos, ao surgirem como objetos sedutores de desejo, também permitem modificar efetivamente o sujeito como tal, operando em ambos os lados da equação da fantasia ($ ◊ a).

O que é especialmente inquietante sobre os gadgets é a convicção de que podem acertar onde as tecnologias anteriores erraram, principalmente porque, em vez de simplesmente fornecer mais um conjunto de substitutos questionáveis, eles pretendem suturar a impotência ou a falta de maneira mais direta.

A IA COMO DESEJO DO INCONSCIENTE

Luiz Alfredo Garcia-Roza (2009) aponta que o desejo, colocado como desejo do inconsciente, é central na teoria psicanalítica de Freud e Lacan. Diferente da necessidade, que pode ser satisfeita por um objeto específico, o desejo é uma relação com um fantasma, não um objeto real e, portanto, nunca é satisfeito. Ele pode se realizar em objetos, mas não se satisfaz com esses objetos. O objeto do desejo é sempre uma falta, uma lembrança de um objeto perdido na infância que continua presente como falta, procurando ser realizado por uma série de substitutos que formam uma rede de significantes que se organizam por contiguidade e similaridade, mantendo a permanência da falta, mas se deslocando por meio da metonímia.

Antes de adentrar o plano do simbólico, o desejo se manifesta no plano do imaginário. Inicialmente, é em referência ao outro ou à imagem do outro que a criança vai construir seu esboço de ego. A partir do primeiro momento em que a criança formou seu eu segundo a imagem do outro, ela vai, ao ingressar na ordem simbólica, produzir uma transformação no objeto por meio da linguagem (Garcia-Roza, 2009, pp. 148–149).

É importante enfatizar que o desejo na psicanálise tem suas origens no desejo de Hegel, que se torna um desejo humano na condição de transformar e assimilar o desejo do outro. “Em outras palavras, só posso afirmar o meu desejo na medida em que nego o desejo do outro e tento impor a esse outro meu próprio Desejo.” (Garcia-Roza, 2009, p. 142). Sendo esse outro também portador de um desejo, há uma luta entre dois desejos que se faz na condição de vida ou morte, ao mesmo tempo que ambos os adversários devem permanecer vivos para que o reconhecimento seja possível. O perdedor, para evitar a morte, aceita ser subjugado e, assim, reconhece o vencedor como seu senhor enquanto se reconhece como escravo (Garcia-Roza, 2009, p. 143).

Ainda, segundo o autor, a relação entre esses dois sujeitos é ilustrada por Lacan com o exemplo do escravo-mensageiro que trazia sob sua cabeleira a mensagem que o condenava à morte, sem que ele mesmo conhecesse o sentido do texto. Portanto, são dois sujeitos que estão em jogo: aquele que enuncia a mensagem (sujeito do enunciado) e aquele outro ligado aos elementos significantes do inconsciente (sujeito da enunciação), excêntrico em relação ao primeiro. A prática psicanalítica se propõe a tornar explícito o sujeito da enunciação, partindo do sujeito do enunciado.

Na interação entre a IA e o usuário, pode-se estabelecer uma relação de contiguidade metonímica, na qual a IA atua como substituto ou representante do objeto de desejo. Como o objeto do desejo é sempre uma falta, e qualquer satisfação obtida é imediatamente seguida por uma insatisfação que mantém o desejo em movimento, mesmo que a IA possa parecer satisfazer as demandas do usuário a curto prazo, ela não consegue preencher a falta fundamental que impulsiona o desejo. A interação do usuário com a IA, nessa relação de contiguidade, é marcada pela impossibilidade.

Na mesma medida em que a IA substitui o objeto de desejo, ela jamais preenche essa falta, mas continua prometendo satisfação, marcando a relação com o usuário por meio dessa impossibilidade, tanto de se fazer laço devido a sua estrutura com o discurso do capitalista, quanto como objeto a marcado pela falta. A IA fornece ao usuário o suficiente para tangenciar seu desejo por meio de textos, ferramentas e imagens que capturam quase que imediatamente aquilo que o usuário busca. No entanto, ela sempre insiste em fornecer exatamente o que se pede, como observado na forma em que sempre entrega de forma positiva, pois mesmo que exista algo do que se pede, ela consegue alucinar respostas. O site do chatbot (https://chatgpt.com) recomenda que informações importantes sejam checadas, pois ele pode cometer erros produzindo respostas incorretas, como dizer que um autor escreveu algo que não escreveu. O ChatGPT, segundo Fredy Heppell et al. (2024), pode gerar desinformação de maneira rápida, barata e em grande escala, que é ao mesmo tempo realista e coerente, específica para certos públicos-alvo. Essas informações geradas são indistinguíveis por humanos ou programas de detecção existentes.

Para Rosane Lustoza (2006), o encontro do sujeito com seu próprio desejo pode ser uma experiência angustiante. O desejo, em sua essência, é sempre o desejo do Outro, e é marcado por uma falta, e a angústia “sinaliza a emergência do desejo do Outro, entendido num registro específico, o do real” (p. 54). Quando o usuário percebe seu próprio desejo refletido na IA, ele se depara com essa falta, presente na sensação constante de que ainda falta algo no que a IA produz, e continua sempre insatisfeito, o que o leva a projetar essa satisfação numa nova IA, mais avançada. Isso pode levar a um movimento angustiante, pois o usuário é confrontado com a impossibilidade de satisfazer completamente seu desejo. Além disso, a IA, como um espelho, reflete não apenas os desejos conscientes do usuário, mas também seus desejos inconscientes. Esses desejos inconscientes remetem à condição de sujeito barrado ($).

Essa dinâmica também se explicita em plataformas de arte gerativa de IA, como o DALL-E 2, uma IA que transforma texto em imagem. Esses sistemas atraem os usuários com a capacidade de renderizar graficamente suas imaginações e desejos mais selvagens. No entanto, embora as saídas possam refletir intimamente os desejos inconscientes do usuário, elas permanecem como imagens estáticas planas que não podem capturar totalmente a cena, como a mente a imagina. Há uma falha e um vazio inevitáveis que bifurcam a expectativa e a realidade. Esse desaparecimento da unicidade do objeto imaginado produz um impulso repetitivo para refinar continuamente os comandos e alcançar a “perfeita” representação da imagem interna. Mas isso permanece impossível, pois a renderização apaga dimensões subjetivas sutis.

É o desejo do próprio usuário que escapa de ser satisfeito, como se talvez a luta entre desejos, tão importante na ideia de Hegel, nunca tivesse a submissão ao desejo do outro, parte porque não há um desejo propriamente dito na IA, parte porque não há um outro. Talvez seja a luta entre desejos na “dialética” do senhor-escravo de Hegel que seja importante para a satisfação. No final, a IA oferta imagens perfeitas de seres humanos que são indiferenciáveis de suas contrapartes reais, mas todos insuficientemente completos como um mar de corpos sem alma.

Assim, o processo contínuo de satisfação das demandas por meio da interação com a IA pode levar ao apagamento do sujeito desejante. A IA oferece substitutos rápidos e aparentemente satisfatórios para os objetos de desejo, obscurecendo a falta que caracteriza o desejo humano e resultando em uma satisfação superficial e ilusória. O desejo, por definição, nunca pode ser plenamente satisfeito, e a IA, ao fornecer sempre uma resposta — mesmo que falsa ou criada — e não impor limites ao sujeito, intensifica essa dinâmica. Suas respostas, imperfeitas e sempre passíveis de melhoria, induzem o sujeito a um ciclo contínuo de ajustes dos prompts na busca de respostas melhores, perpetuando a insatisfação.

A ausência de barreiras reais ao desejo impede a experiência autêntica da falta, elemento central na constituição subjetiva. Como constante fonte de substituição metonímica, a IA mantém o sujeito preso em uma busca interminável por satisfação, eliminando a profundidade da experiência desejante e promovendo seu apagamento. Assim, o desejo, essencialmente constituído pela falta e pelo desejo do Outro, perde vitalidade diante de um substituto desprovido de subjetividade, transformando o sujeito em um consumidor passivo e alienado da verdadeira dinâmica desejante.

TRAÇO UNÁRIO, APAGAMENTO E REPETIÇÃO

Na teoria de Lacan (1961–1962/2003), o traço unário é um elemento fundamental na constituição do sujeito na linguagem. Para Brenda Neves e Ângela Vorcaro (2011), ele é “o significante que marca a diferença fundamental, retirando o ser de sua condição de pura necessidade e inserindo-o no campo do Outro, da linguagem.” (p. 282). Também é o instrumento da identificação do sujeito que tem plena relação com a estrutura simbólica. O sujeito é o efeito do apagamento de traços de alteridade que permite sua entrada na linguagem.

O apagamento, na teoria lacaniana, designa o processo pelo qual o sujeito se forma ao se submeter à linguagem e ao Outro, substituindo seus traços originais pelos traços unários, segundo Éverton Cordeiro e Márcia Luchina (2017). Os traços originais do sujeito são apagados e substituídos pelos traços unários da linguagem. A repetição busca a unicidade do significante original perdido, assegurada pela função de fundação do traço unário (Neves e Vorcaro, 2011).

No inconsciente, a repetição busca a unicidade do significante original, irremediavelmente perdida. Esse processo de constituição do sujeito e a repetição de experiências de satisfação ocorrem antes que o sujeito esteja consciente desses mecanismos. Sem perceber, o sujeito repete, afastando-se de sua existência vital. Há uma privação real de um objeto simbólico, não pelo interdito, mas pelo não dito. Inicialmente, há um vazio (-1) onde o sujeito ainda não é subjetividade. Na interação entre desejo e demanda do Outro, marca-se a privação do sujeito, que erroneamente acredita em um objeto pleno no Outro que trará satisfação total. (Neves e Vorcaro, 2011).

O estudo do desenvolvimento de IA pode ser visto pelo conceito de apagamento que a aproxima de uma condição do desenvolvimento humano. Desde seu desenvolvimento, com base de dados que apagam seus autores originais até o seu processo de treinamento, sem envolvimento dos artistas que contribuem para a base de IAs que utilizam a mesma base de dados, podem gerar resultados diferentes, levantando a possibilidade de uma tentativa de retirar traços de alteridade, da mesma forma que ocorre com o sujeito na inscrição no campo do Outro no traço unário. Os dados utilizados para treinar uma Inteligência Artificial são transformados de maneira comparável a uma série de traços unários que são desprovidos de seu contexto original.

A ideia de Lacan (1961–1962/2003) de que a repetição no inconsciente é a busca da unicidade do significante original, para sempre perdida, faz refletir sobre a maneira como a IA gera novas saídas com base nos mesmos dados de treinamento, sempre em busca de produzir um resultado ideal. Cada saída é uma tentativa de repetir e recriar os padrões encontrados nos dados, mas o contexto original e a unicidade dos dados são perdidos nesse processo.

Parece haver o apagamento na produção das IAs em três etapas. Há o apagamento do sujeito na base de dados, na medida em que os autores são retirados pelos algoritmos e modelos de treinamento dos seus resultados finais. O apagamento da diferença na padronização de características na classificação de IAs de vigilância. E o terceiro apagamento, dos sujeitos que são impactados na extração dos componentes físicos da IA, como o lítio e os trabalhadores encarregados pelas rotulações de dados, postos em condições sub-humanas de trabalho. Convém distinguir que certos apagamentos, como a eliminação de contexto necessária à extração de dados, são constitutivos do funcionamento da IA e, portanto, inelimináveis; contudo, é dentro da racionalidade capitalista que esses apagamentos adquirem contornos mais problemáticos, pois são instrumentalizados em favor de lógicas de acumulação, vigilância e performatividade algorítmica.

Rastrear os arcos de desenvolvimento dessas tecnologias esclarece os processos de apagamento também criticados. Os dados de treinamento para chatbots e IA generativa contêm imensas entradas textuais e visuais de multidões de criadores humanos. No entanto, todos os marcadores contextuais dessas obras originais são retirados à medida que os algoritmos analisam os dados em busca de padrões. As nuances do estilo e intenção do autor são ocultadas, pois os conjuntos de dados são achatados em agregados estatísticos para otimização computacional. Há um profundo apagamento de sujeitos humanos criativos que sustentam as “visões” finais que essas IAs produzem para os ávidos consumidores de tecnologia.

Há um outro tipo de apagamento incluso e presente no horizonte dessa tecnologia. Existe uma busca constante por um programa ideal, uma IA isenta, neutra e sem viés. O objetivo final de uma IA perfeita é ser totalmente neutra, incapaz de se posicionar e incapaz de afetar negativamente a experiência de qualquer usuário, antípoda do mundo em que vivemos. Porém, isso que se busca apagar é o que é essencialmente humano, acentuando o distanciamento e desconexão que marcam a contemporaneidade e demonstrando que não é possível pensar sobre as IAs sem pensar no contexto social em que ela está inserida.

Por fim, há um apagamento do lúdico-criativo, da diversidade e da autonomia subjetiva. As IAs possibilitam automatizar uma ampla gama de tarefas, desde as mais simples, como agendar compromissos, até as mais complexas, como escrever relatórios, corrigir textos ou criar designs gráficos. Muitos serviços online usam IA para fornecer recomendações personalizadas com base no comportamento passado do usuário, recortando o que chega de informação até esse usuário.

CONCLUSÃO

Lidar com questões éticas relacionadas com a IA é extremamente complexo. Por um lado, os vieses aprendidos desses programas podem perpetuar ou amplificar processos discriminatórios já existentes na nossa sociedade. Por outro lado, mesmo que fosse possível eliminar os vieses desses modelos, outras informações que são descritivas ou eticamente úteis também poderiam ser eliminadas no processo. Essa relação de causalidade entre informação e viés é tão complexa como no universo humano, lançando reflexões importantes para o próprio sujeito e sua relação com seu posicionamento ético.

A própria produção das IAs é um desafio ético, como visto no percurso deste trabalho. É preciso pensar em como tornar a sua produção mais justa e digna aos trabalhadores, tanto os envolvidos com suas partes físicas, como os mineradores de lítio, quanto os que atuam naquelas não físicas, como os rotuladores de dados ou os artistas que têm seus trabalhos roubados para alimentar a base de dados.

Além disso, embora a IA seja regulada para impedir o uso antiético por parte dos usuários, os códigos de programação podem ser acessados e modificados, gerando novas versões sem restrições que são comumente encontradas compartilhadas nos fóruns da internet, permitindo, por exemplo, a modificação de fotos sem restrições e a criação de fake News que podem ser utilizadas para qualquer fim.

A própria subjetividade sofre consequências conforme essas tecnologias se desenvolvem. Pessoas são escolhidas sem justificativa pelos sistemas de segurança de aeroportos por conta de suas características físicas, sem ter uma resposta satisfatória do porquê. Outras têm suas fotos modificadas sem nenhuma autorização, podendo ser expostas de forma indevida e sem ter como provar que a imagem não é real. Há também a intensificação da dependência tecnológica que esses programas geram, uma vez que eles foram criados com a intenção de serem atraentes e úteis para os mais diversos setores. E, por último, há um certo tipo de analfabetismo tecnológico comparado ao dos novos dispositivos eletrônicos, uma vez que os comandos influenciam muito no tipo de resposta que a IA irá produzir.

Pensar uma ética que não envolva os sujeitos (no caso, os usuários) em seu próprio desejo se mostra ineficiente. Nesse ponto, a psicanálise é fundamental, pois ela insere novamente o sujeito nas dinâmicas relacionais, sejam elas relações humanas ou de humanos com máquinas. A construção de IAs éticas está alinhada ao contexto social e ao sistema no qual o modo de produção capitalista define a demanda e a flexibilidade ética. O apagamento do sujeito é oferecido como uma solução simples para problemas complexos, pois se busca neutralidade e eficiência em detrimento da singularidade e da subjetividade humana.

A proximidade da IA ao objeto a permite que esse seja um produto altamente lucrativo e atrativo ao consumo. Enquanto isso, as empresas ligadas ao desenvolvimento dessas tecnologias não são responsabilizadas pelo que seus programas produzem. É também nesse ponto que a discussão e a articulação dos conceitos psicanalíticos são um caminho possível para se pensar tais questões e devolver o sujeito ao seu lugar falante na articulação com o seu desejo. Um sujeito implicado em seu próprio desejo é um sujeito implicado socialmente na sua forma de se relacionar.

Embora este artigo explore como o capitalismo molda o desenvolvimento da inteligência artificial, há espaço para analisar os mecanismos específicos pelos quais as demandas capitalistas impactam a ética da tecnologia. As empresas privadas investem bilhões no setor de IA, o ritmo de desenvolvimento frequentemente ultrapassa as verificações e equilíbrios éticos. A priorização das margens de lucro e dos retornos aos acionistas impulsiona ciclos rápidos de lançamento de produtos sem revisão e regulação suficientes. As pressões competitivas no setor de tecnologia desincentivam o reconhecimento aberto de falhas ou impactos sociais prejudiciais dos sistemas de IA. As regulamentações lutam para conter essas forças ou são implementadas muito lentamente para acompanhar as pressões do mercado. Tudo isso fica claro, pois soluções puramente técnicas falham em resolver questões éticas na produção de IAs. As estruturas econômicas e incentivos em ambientes capitalistas parecem tornar os desvios éticos inevitáveis. Reexaminar esses impulsionadores sistêmicos é crucial para a composição do humano, do progresso e da “vida” tecnológica.

REFERÊNCIAS

Aïvodji, Ulrich; Arai, Hiromi; Fortineau, Olivier; Gambs, Sébastien; Hara, Satoshi, & Tapp, Alain. (2019). Fairwashing: The risk of rationalization. arXiv:1901.09749v3 [cs.LG]. https://doi.org/10.48550/arXiv.1901.09749

Browne, Simone. (2010). Digital epidermalization: Race, identity and biometrics. Critical Sociology, 36(1), 131–150. https://doi.org/10.1177/0896920509347144

Cordeiro, Éverton Fernandes, & Luchina, Márcia Maria Rosa Vieira. (2017). El inconsciente – del sentido del significante al goce de la letra: un estudio lacaniano. Avances en Psicología Latinoamericana, 35(3), 583–600. https://doi.org/10.12804/revistas.urosario.edu.co/apl/a.4317

Durr, Steven; Mroueh, Youssef; Tu, Yuhai, & Wang, Shenshen. (2022). Effective dynamics of generative adversarial networks. arXiv:2212.04580 [cs.LG]. https://doi.org/10.48550/arXiv.2212.04580

Fanon, Franz. (1952/2020). Pele negra, máscaras brancas (S. Nascimento, Trad.). Ubu Editora.

Garcia-Roza, Luiz Alfredo. (2009). Freud e o inconsciente (24. ed.). Jorge Zahar Ed.

Heppell, Fredy; Bakir, Mehet E., & Bontcheva, Kalina. (2024). Lying blindly: Bypassing ChatGPT’s safeguards to generate hard-to-detect disinformation claims at scale. arXiv:2402.08467 [cs.CL]. https://doi.org/10.48550/arXiv.2402.08467

Lacan, Jacques. (1954/2010). O seminário, livro 2: o eu na teoria de Freud e na técnica da psicanálise. Jorge Zahar.

Lacan, Jacques. (1961–1962/2003). O seminário, livro 9. A identificação. Centro de Estudos Freudianos do Recife.

Lacan, Jacques. (1964/1993). Os quatro conceitos fundamentais em psicanálise (O Seminário, Livro 11). Zahar.

Lacan, Jacques. (1969–1970/1992). O seminário, livro 17: O avesso da psicanálise. Jorge Zahar.

Lacan, Jacques. (1969–1970/2011). Estou falando com as paredes. Jorge Zahar.

Lacan, Jacques. (1972). Du discours psychanalytique: Conférence à l’université de Milan. https://ecole-lacanienne.net/wp-content/uploads/2016/04/1972-05-12.pdf

Lustoza, Rosane Zétola. (2006). A angústia como sinal do desejo do Outro. Revista Mal-Estar e Subjetividade, 6(1), 44–66. http://pepsic.bvsalud.org/scielo.php?script=sci_arttext&pid=S1518-61482006000100004

Monteiro, Jamile Luz Morais. (2019). A cisão entre o sujeito e o saber no discurso capitalista. Ágora: Estudos em Teoria Psicanalítica, 22(2), 164–172. https://doi.org/10.1590/1809-44142019002003

Neves, Brenda Rodrigues da Costa, & Vorcaro, Ângela Maria Resende. (2011). Breve discussão sobre o traço unário e o objeto a na constituição subjetiva. Psicologia em Revista, 17(2). http://pepsic.bvsalud.org/scielo.php?script=sci_arttext&pid=S1677-11682011000200008

Salvagno, Michele; Taccone, Fabio Silvio, & Gerli, Alberto Giovanni. (2023). Can artificial intelligence help for scientific writing? Critical Care, 27, 75. https://doi.org/10.1186/s13054-023-04380-2

Schubert, Lenhart. (2020). Computational linguistics. In Edward N. Zalta (Ed.), The Stanford encyclopedia of philosophy (Spring 2020 Edition). Standford. https://plato.stanford.edu/archives/spr2020/entries/computational-linguistics/

Shen, Yifei; Shao, Jiawei; Zhang, Xinjie; Lin, Zehong; Pan, Hao; Li, Dongsheng; Zhang, Jun, & Letaief, Khaled B. (2023). Large language models empowered autonomous edge AI for connected intelligence. IEEE Communication Magazine. arXiv:2307.02779v3 [cs.IT]. https://doi.org/10.48550/arXiv.2307.02779

Thormundsson, Bergur. (2023). Artificial intelligence (AI) startup funding worldwide from 2011 to 2023 (in billion U.S. dollars), by quarter. Statista. https://www.statista.com/statistics/943151/ai-funding-worldwide-by-quarter/

Thorn, Abgail. (2023). Here’s what ethical AI really means [Vídeo]. YouTube. https://www.youtube.com/watch?v=AaU6tI2pb3M

Zwart, Hub. (2017). “Extimate” technologies and techno-cultural discontent: A Lacanian analysis of pervasive gadgets. Techné: Research in Philosophy and Technology, 21(1), 24–55. https://doi.org/10.5840/techne20174560

PAULO VICTOR DOS REIS SILVEIRA

Mestre e Doutorando pelo Instituto de Psicologia, Programa de Pós-graduação em Psicologia da Universidade Federal de Uberlândia (UFU), Uberlândia/MG, Brasil.

paulo.silveira1@ufu.br

https://orcid.org/0000-0002-4617-2620

JOÃO LUIZ LEITÃO PARAVIDINI

Doutor em Ciências da Saúde (Saúde Mental) pela Universidade Estadual de Campinas (Unicamp). Docente do Instituto de Psicologia - Universidade Federal de Uberlândia (UFU), Uberlândia/MG, Brasil.

paravidini@ufu.br

https://orcid.org/0000-0002-2685-3808

ANAMARIA SILVA NEVES

Doutora em Psicologia (USP). Professora Titular no Instituto de Psicologia, Curso de Graduação e Programa de Pós-Graduação em Psicologia, Uberlândia/MG, Brasil.

anamaria.neves@ufu.br

https://orcid.org/0000-0003-2130-7960

FORMATO DE CITAÇÃO

Silveira, Paulo Victor dos Reis; Paravidini, João Luiz Leitão, & Neves, Anamaria Silva. (2026). Inteligência artificial, desejo e apagamento: Uma perspectiva psicanalítica. Quaderns de Psicologia, 28(1), e2232.

https://doi.org/10.5565/rev/qpsicologia.2232

HISTÓRIA EDITORIAL

Recebido: 9-10-2024

1ª revisão: 13-12-2024

2ª revisão: 17-1-2025

Aceito: 1-2-2025

Publicado: 25-04-2026